生成 AI と人間参加型アプローチの連携

Reena Jana

Head of AI Research & Standards, Trust & Safety, Google

※この投稿は米国時間 2026 年 2 月 20 日に、Google Cloud blog に投稿されたものの抄訳です。

生成 AI は、複雑な計算や大量の情報の統合に優れています。動画の生成やブログ記事の作成のほか、バイブ コーディングにも利用できます。しかし、生成 AI には再現できない独自の専門知識や経験を持つ人間による入力は、AI を導き、監督するうえで依然として不可欠なものです。人間と機械の知能を組み合わせる方法の一つに、「人間参加型」アプローチがあります。

人間参加型とは、人間が自身の専門知識、状況の理解力、専門的な判断力を活用して AI と連携することで、生成 AI のデータ収集能力と生成機能の可能性を最大限に活用しつつ、出力を改良することです。このアプローチは、ユーザーが使用する生成 AI ツールの開発にも使用されています。人間は AI モデルと連携してモデルをトレーニングし、経時的にパフォーマンス評価を実施します。また、安全に関する複雑なガイドラインを AI モデルが解釈する方法をファインチューニングするために、人間の専門知識を適用します。人間は、これらのモデルを現実世界のニュアンスに照らして評価することで、すべてのやり取りにおいて、テクノロジーが一貫して有用かつ信頼できるものになるよう支援します。

人間参加型アプローチは、品質、生産性、信頼性において、人間と AI のコラボレーションのメリットを最大限に引き出し、両者の長所を組み合わせることでタスクの完了と目標の達成を支援します。

仕組み

人間参加型アプローチは新しい用語のように思えるかもしれませんが、数十年の歴史があり、AI 以前の自動化システムのコンテキストとして初めて使用されました。例として、飛行機の自動操縦を考えてみてください。飛行機の航路を維持するためには、数十ものセンサーや信号からのデータポイントが使用されますが、それらが最終的な判断を下すことはありません。

センサーの故障やシステムの不具合が生じた場合や、特に難しい操作が必要になる場合に備えて、熟練したパイロットが常に操縦桿を握っています。テクノロジーと人間の双方の強みを活かしたこのアプローチは、セーフティ ネットを維持しつつ、人間の負担を軽減できます。

潜在的な影響を評価する

私たちは日々、メールの推敲から契約書のレビュー、がん研究に至るまで、あらゆる場面で生成 AI を使用しています。すべての出力を徹底的に精査する必要はありません。

むしろ、その出力がどのような影響を与えるかを考慮し、目的にとって最も重要な要素に合うよう確認作業を調整することが有効です。その際は、以下を考慮します。

- リスク: 影響が小さい判断の場合は、監督にあまり手間をかけずに済むことがあります。一方、取り返しのつかない判断を下す場合や大量のリソースが関わる場合は、より厳格な精査が必要です。

- 規模: 多くの人に影響を与える可能性のある判断は、たとえ小さな影響であっても、厳格な精査によってメリットが得られる場合があります。

重要な知識を把握し、適切な人材を見つける

船が航路を定めるために航海士を必要とするように、人間参加型アプローチでは、常に専門家の判断によって AI が導かれることを保証します。

審査の担当者には、以下のような条件が求められます。

- タスクのコンテキストを理解している

- 入力データの正確性を保証できる

- 出力がどのように使用されるかを把握している

- 新しい課題や問題に対するロジックやアプローチを検証できる

人間は不確実性に対処する能力に優れているため、適切な人間が参加することで、潜在的な知識のギャップを考慮したうえで AI 出力の活用方法を判断できます。多くの場合、AI による出力を作成した人物がその出力も評価できます。

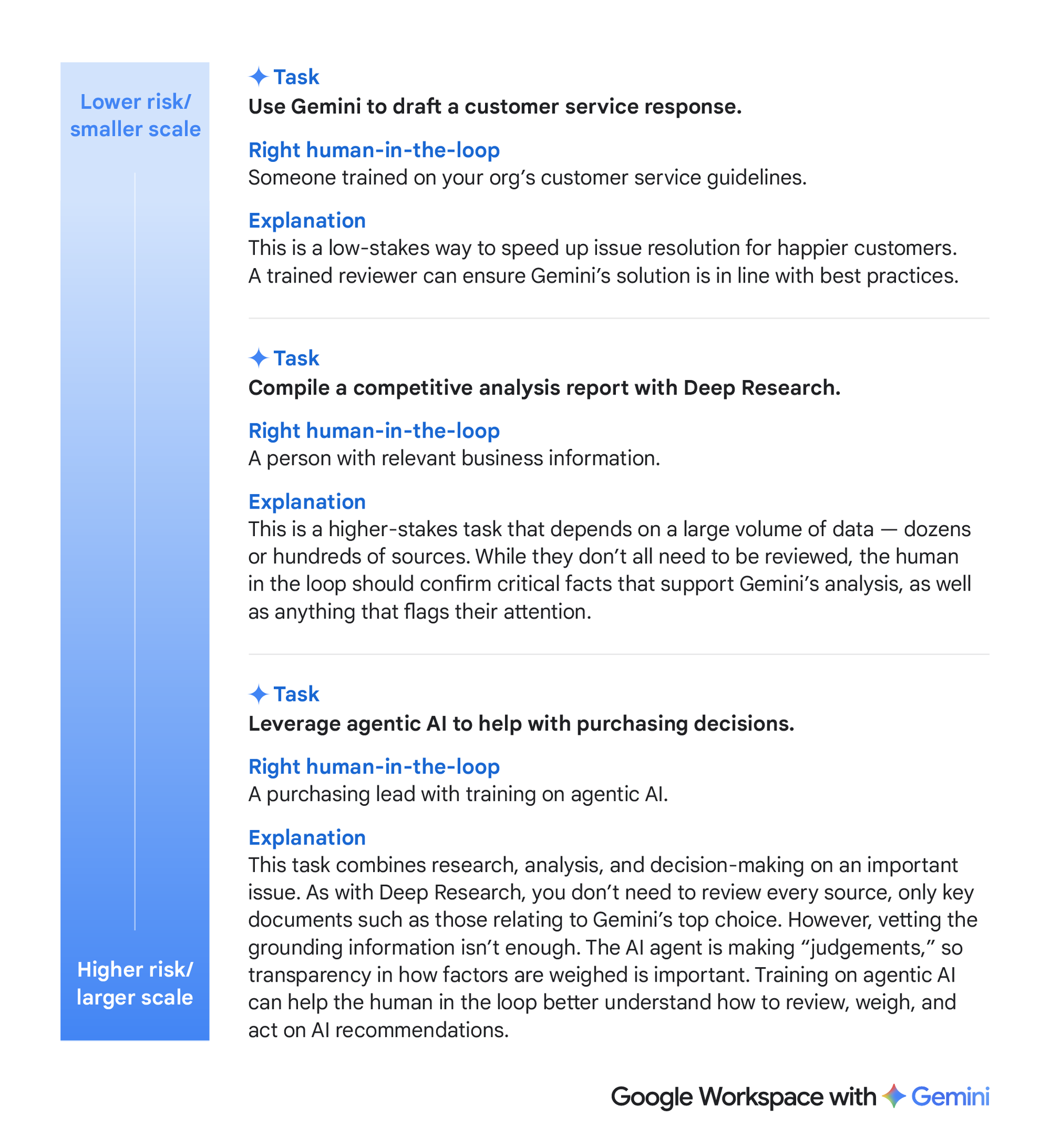

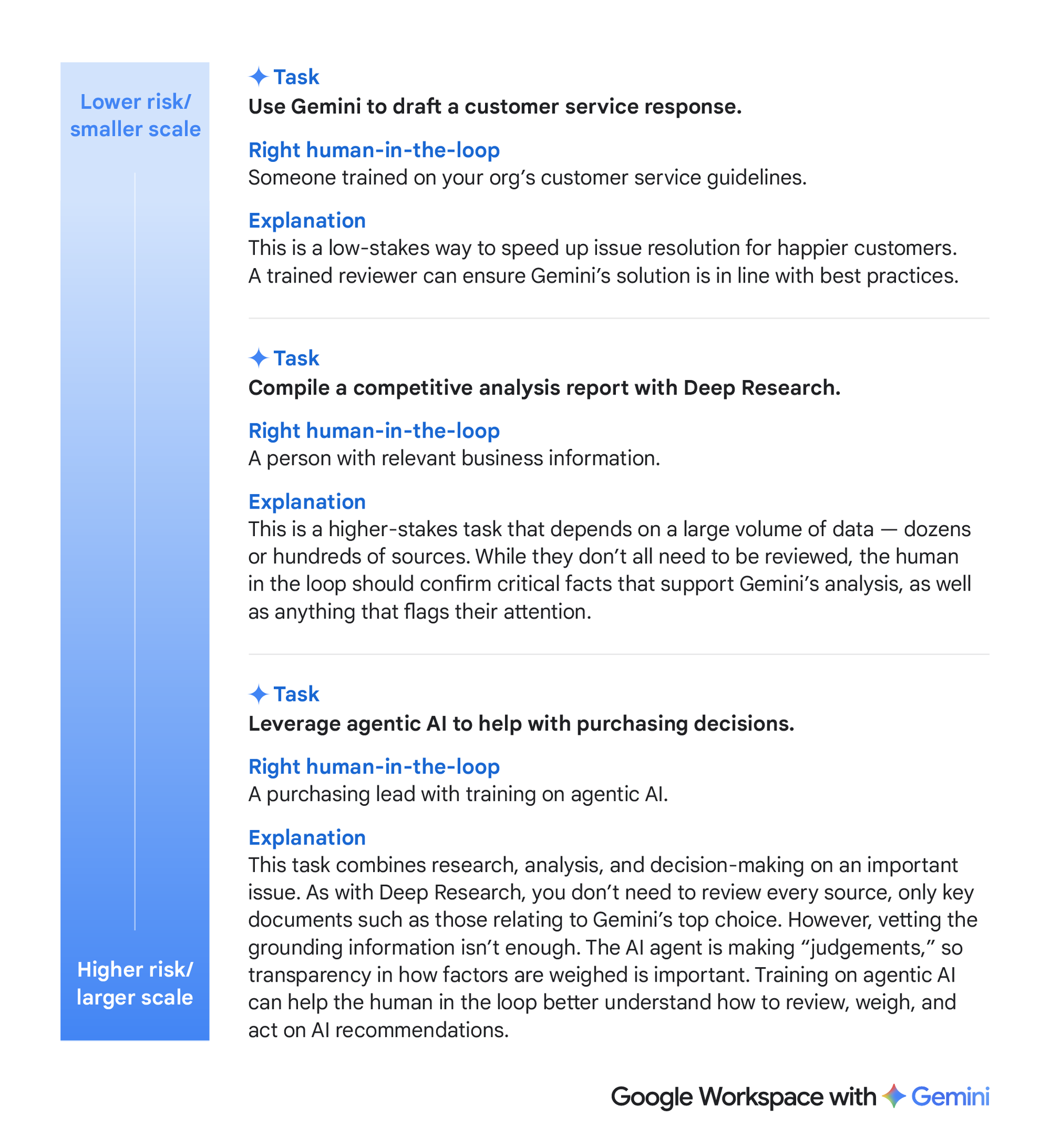

ガイドラインの例を次に示します。

連携のメリット

人間参加型アプローチは、人間の専門知識と AI のデータ処理能力という双方の強みを最大限に引き出す、人間と AI のパートナーシップです。この連携によって、出力の精度、品質、ユーザビリティが向上するだけでなく、人間の作業者にもメリットがもたらされます。AI をうまく活用すれば、重要度の低い、時間のかかるタスクに労力を費やす必要がなくなります。また、人間参加型アプローチの場合は、AI を活用したワークフローを構築する際に、人間がいつでも制御できるという安心感を持つことができます。

- Google、AI 研究・基準担当責任者、Trust & Safety、Reena Jana